Vous avez trouvé cela utile ? Partagez-le avec vos collègues.

Introduction

L’intelligence artificielle (IA) est désormais implantée dans les entreprises. Les opportunités sont vastes, mais les risques augmentent . De nombreuses organisations sont aujourd’hui confrontées à des problèmes liés au manque de transparence des décisions, à la complexité croissante de la technologie, à la protection des données et à l’incertitude juridique.

La loi européenne sur l’intelligence artificielle est la première législation en Europe visant à encadrer l’intelligence artificielle. Elle est entrée en vigueur en juillet 2024. Les principales obligations s’appliqueront à partir d’août 2026 et concerneront toutes les organisations qui développent ou utilisent des systèmes IA dans l’Union européenne. En pratique, cela inclut presque toutes les entreprises.

Évaluez dès maintenant votre niveau de préparation et découvrez si vos systèmes d’IA sont concernés par la loi européenne sur l’intelligence artificielle.

Les organisations doivent garantir la transparence dans le traitement des données et la supervision de leurs systèmes IA. Elles doivent également prouver que leurs systèmes fonctionnent en sécurité et respectent les exigences légales.

Cet article explique comment transformer les exigences de la loi européenne sur l’intelligence artificielle en mesures de gouvernance concrètes, et comment ADOGRC peut aider les organisations à atteindre un véritable niveau de préparation.

Pourquoi la GRC est la clé pour être conforme à la loi sur l’IA

Pour les organisations souhaitant déployer l’IA de manière responsable, il est essentiel de ne pas considérer les systèmes d’IA isolément, mais de les intégrer dans des structures clairement définies. La loi sur l’IA précise que l’utilisation responsable de l’IA n’est possible que si les entreprises sont capables de gérer et de démontrer les risques de manière transparente.

C’est la raison pour laquelle une base GRC solide est indispensable :

-

Des structures de responsabilité et de contrôle : définir clairement qui est responsable de quelles décisions.

-

Des procédures d’évaluation des risques : identifier dès le départ les biais, décisions opaques ou vulnérabilités de sécurité.

-

Une documentation fiable et vérifiable : fournir une documentation solide pour les auditeurs et parties prenantes.

-

Une base de confiance : garantir que l’IA n’est pas perçue comme une boîte noire, mais comme un outil traçable et explicable.

En transformant les exigences fondamentales de la loi européenne sur l’intelligence artificielle en processus, politiques, contrôles et mesures concrets, la GRC joue un rôle central dans l’assurance de la conformité et de la responsabilité dans l’utilisation de l’IA.

Les exigences principales de la loi européenne sur l’intelligence artificielle

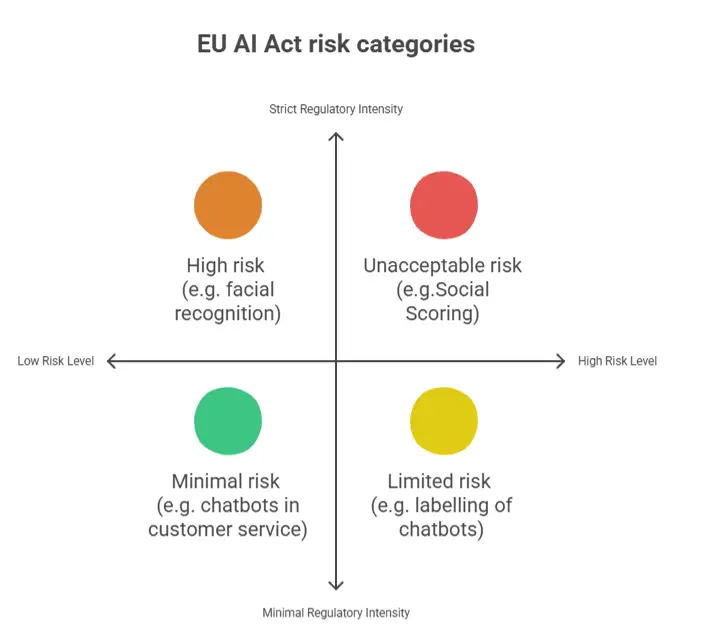

Les catégories de risque de la loi européenne sur l’intelligence artificielle

Les systèmes à haut risque sont soumis à des obligations importantes :

-

Documentation et preuves : couverture des données, des processus de formation et des chemins décisionnels.

-

Transparence et explicabilité : les modèles doivent être compréhensibles et justifiables.

-

Supervision humaine : un contrôle actif des décisions critiques est nécessaire.

-

Auditabilité : les systèmes doivent pouvoir être examinés et tracés à tout moment.

Répondre à ces exigences est quasiment impossible sans une gouvernance structurée.

Selon Gartner® (2024), 57 % des organisations n’ont pas encore mis en place les structures et mécanismes de contrôle nécessaires pour déployer l’IA en toute sécurité. En d’autres termes, la majorité n’est pas encore prête pour l’IA, ce qui fait de l’action une priorité immédiate.

La GRC comme un levier pour se préparer à la loi sur l’intelligence artificielle

L’usage responsable de l’IA repose sur une base solide — une base que fournit la GRC. Ses trois dimensions principales se transforment directement en préparation à la loi sur l’intelligence artificielle :

1. Gouvernance et protection des données

- Assurer et documenter l’origine et la qualité des données de formation. Les organisations doivent pouvoir prouver à tout moment d’où proviennent leurs données et qu’elles sont adaptées pour construire des modèles fiables.

- Harmoniser les exigences du RGPD et de la loi sur l’intelligence artificielle, conformément aux principes de qualité et de transparence des données.

2. Gestion des risques et contrôle interne

- Identifier les risques spécifiques à l’utilisation de l’IA, tels que les biais, les défaillances de modèles ou les décisions incorrectes.

- Mettre en place des contrôles pour la transparence, la validation des modèles et la supervision humaine. Une approche structurée de surveillance garantit que les décisions restent explicables et maîtrisables.

3. Conformité et alignement réglementaire

- Intégrer les exigences de la loi sur l’intelligence artificielle avec des standards tels que ISO/IEC 42001 ou NIST AI RMF, dans le cadre des programmes de conformité existants.

- Centraliser toutes les preuves, évaluations et mesures pour assurer l’auditabilité et la traçabilité sur le long terme.

Avec une base GRC solide, les organisations mettent en place un système de contrôle intégré qui rend le déploiement de l’IA non seulement conforme, mais aussi évolutive et fiable. En standardisant les processus, en définissant clairement les responsabilités et en gérant systématiquement les risques, ils deviennent réellement prêts pour l’IA.

Astuce : découvrez pourquoi la préparation à l’IA repose sur la GRC et comment elle constitue la base d’une IA responsable et évolutive.

Des principes aux processus : opérationnaliser la loi sur l’intelligence artificielle avec ADOGRC

Beaucoup d’organisations ont déjà défini leurs lignes directrices pour l’utilisation de l’IA, mais manquent souvent de modèles opérationnels pour les appliquer efficacement. C’est là qu’ADOGRC entre en jeu :

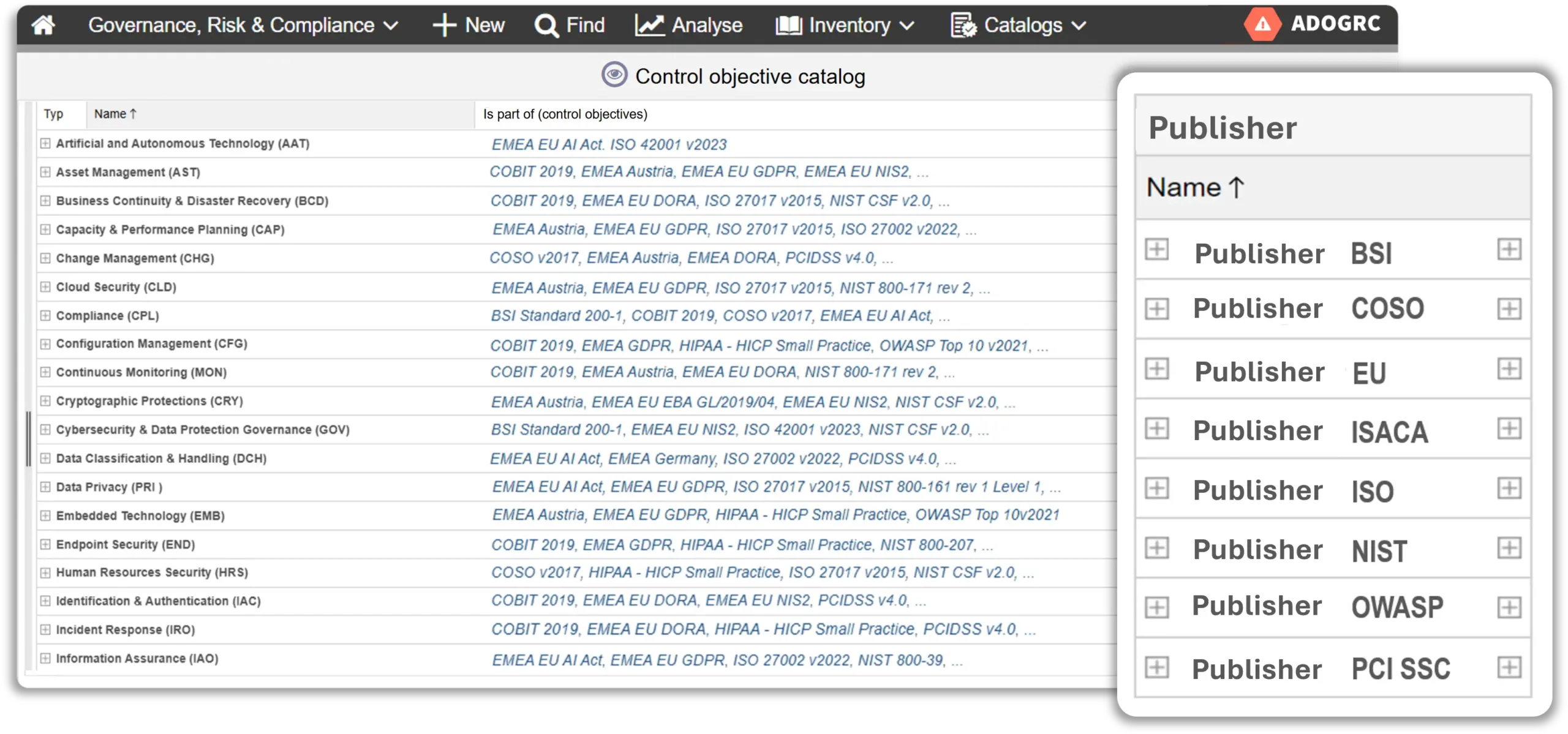

Librairie de conformité centralisée

Toutes les exigences réglementaires — de la loi sur l’intelligence artificielle aux standards du marché — sont centralisées, maintenues et mises à jour dans ADOGRC. Cela crée une source unique de vérité pour toutes les obligations liées à l’IA.

La librairie de conformité d’ADOGRC

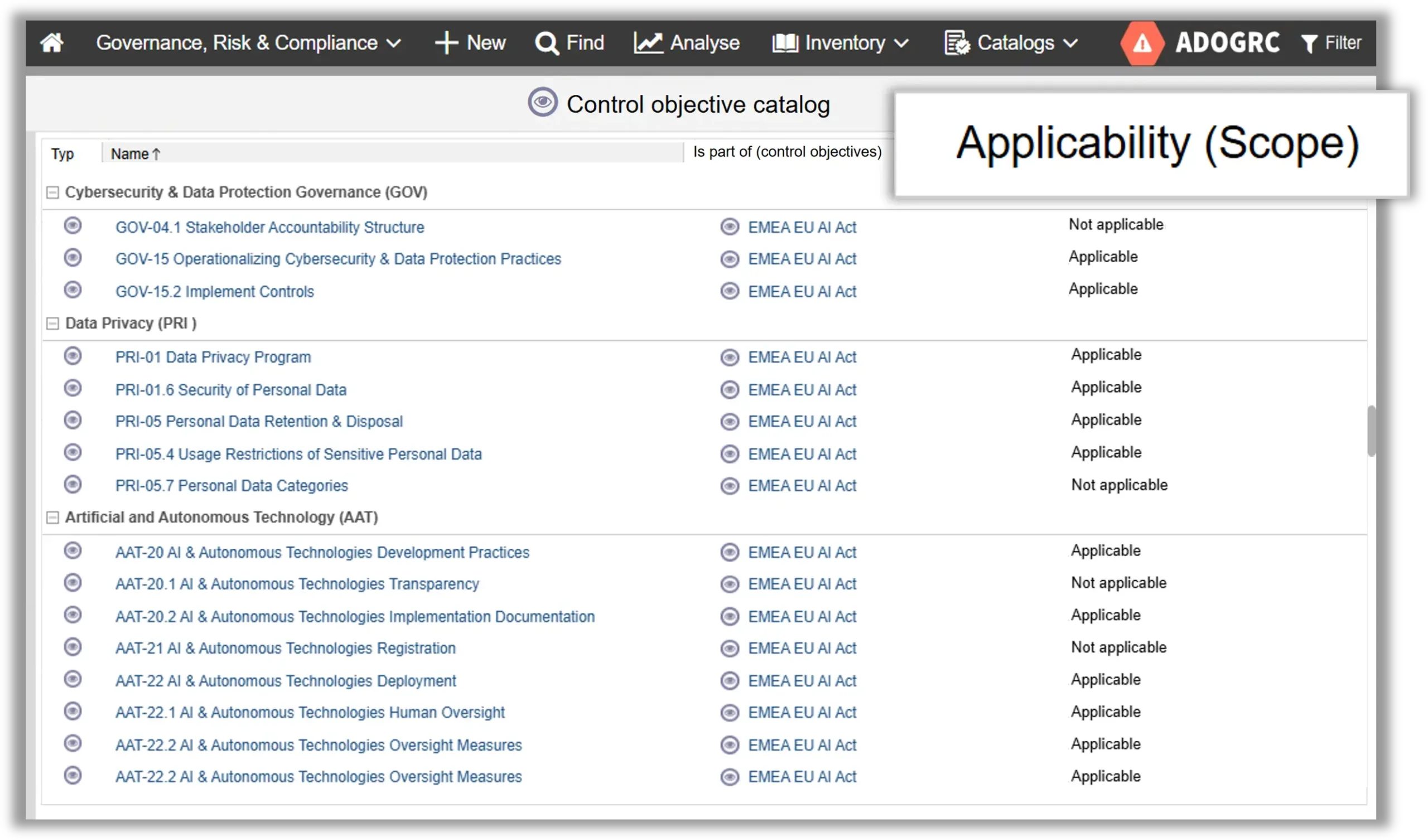

Définition du périmètre et évaluation de la pertinence

Avec ADOGRC, vous pouvez identifier quelles exigences de la loi sur l’intelligence artificielle et des autres réglementations sont réellement pertinentes pour votre organisation, vos systèmes d’IA et vos cas d’usage.

Les spécifications pertinentes en un coup d’œil

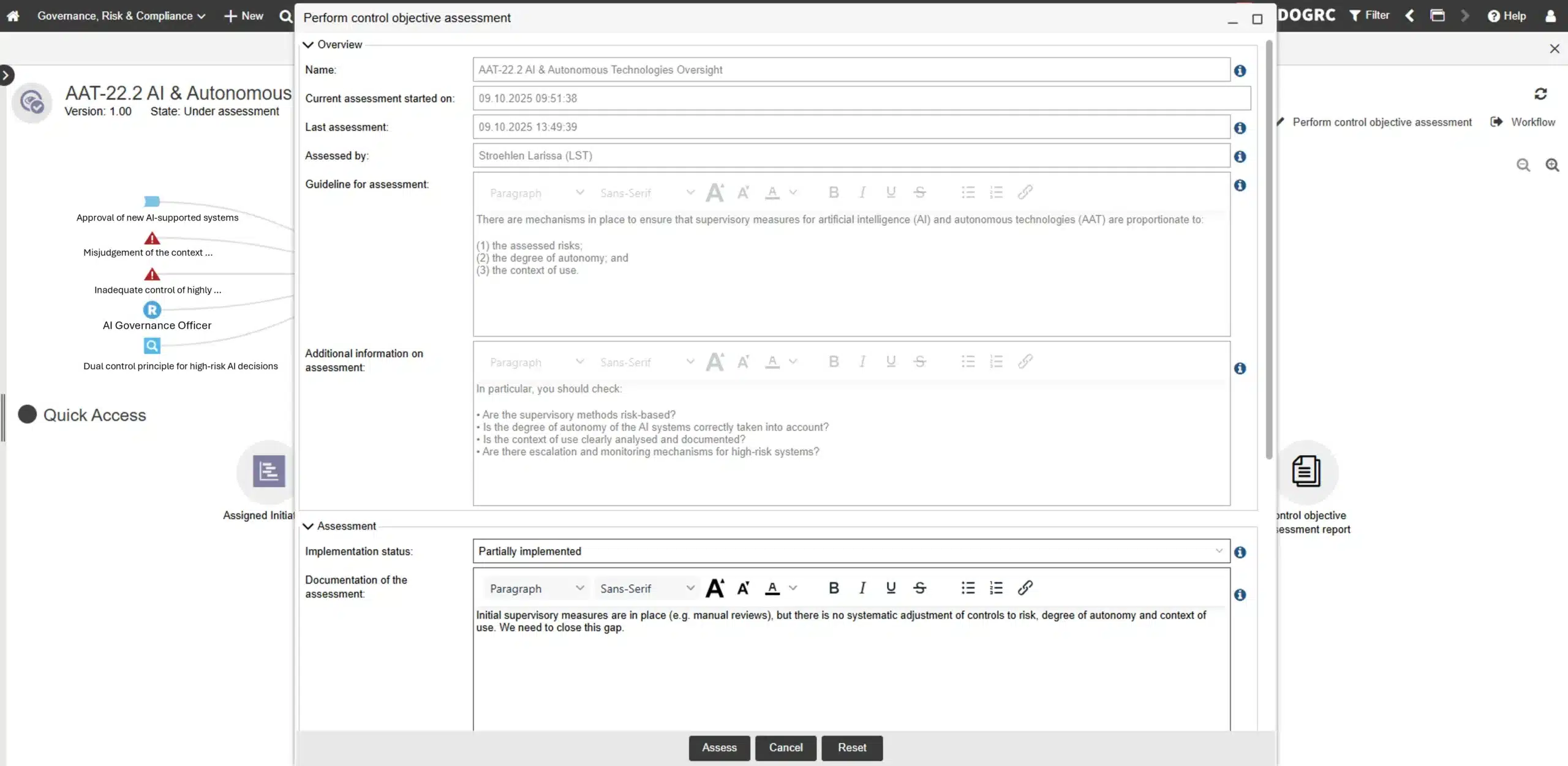

Évaluation prête pour l’audit

Grâce aux évaluations standardisées dans ADOGRC, vous pouvez vérifier que les exigences de la loi sur l’intelligence artificielle sont respectées — documentées, traçables et prêtes pour l’audit. Des vues détaillées permettent de mettre en évidence immédiatement les écarts et les axes d’amélioration.

Vue détaillée de l’évaluation des exigences

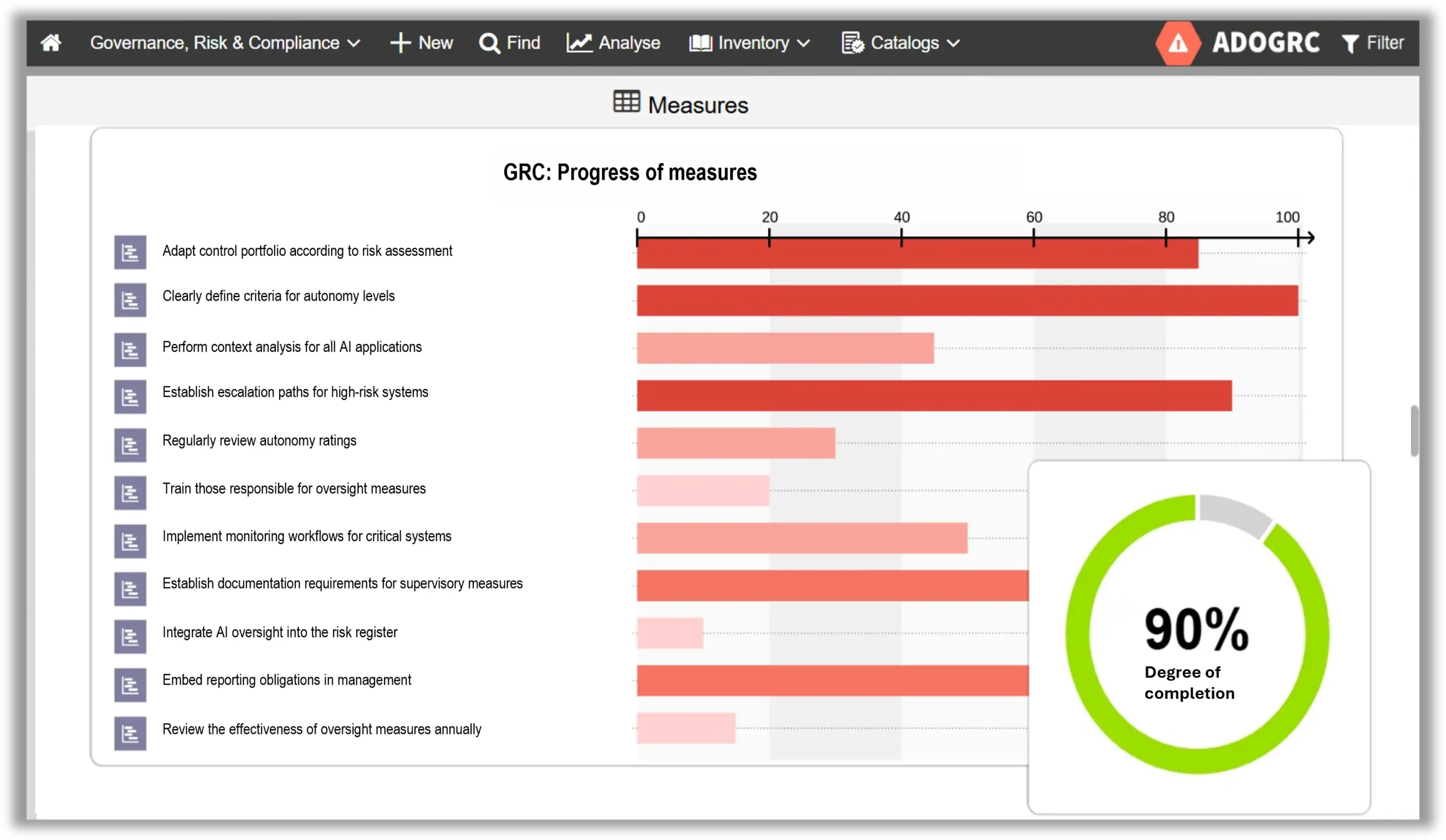

Suivi des actions

À partir de l’évaluation de vos exigences, vous pouvez définir et gérer les actions directement dans ADOGRC. L’outil garantit, grâce à des workflows automatisés, que les responsabilités sont attribuées, les échéances fixées et l’avancement documenté de manière transparente. Ainsi, aucune étape du processus de conformité à la loi sur l’IA ne passe inaperçue.

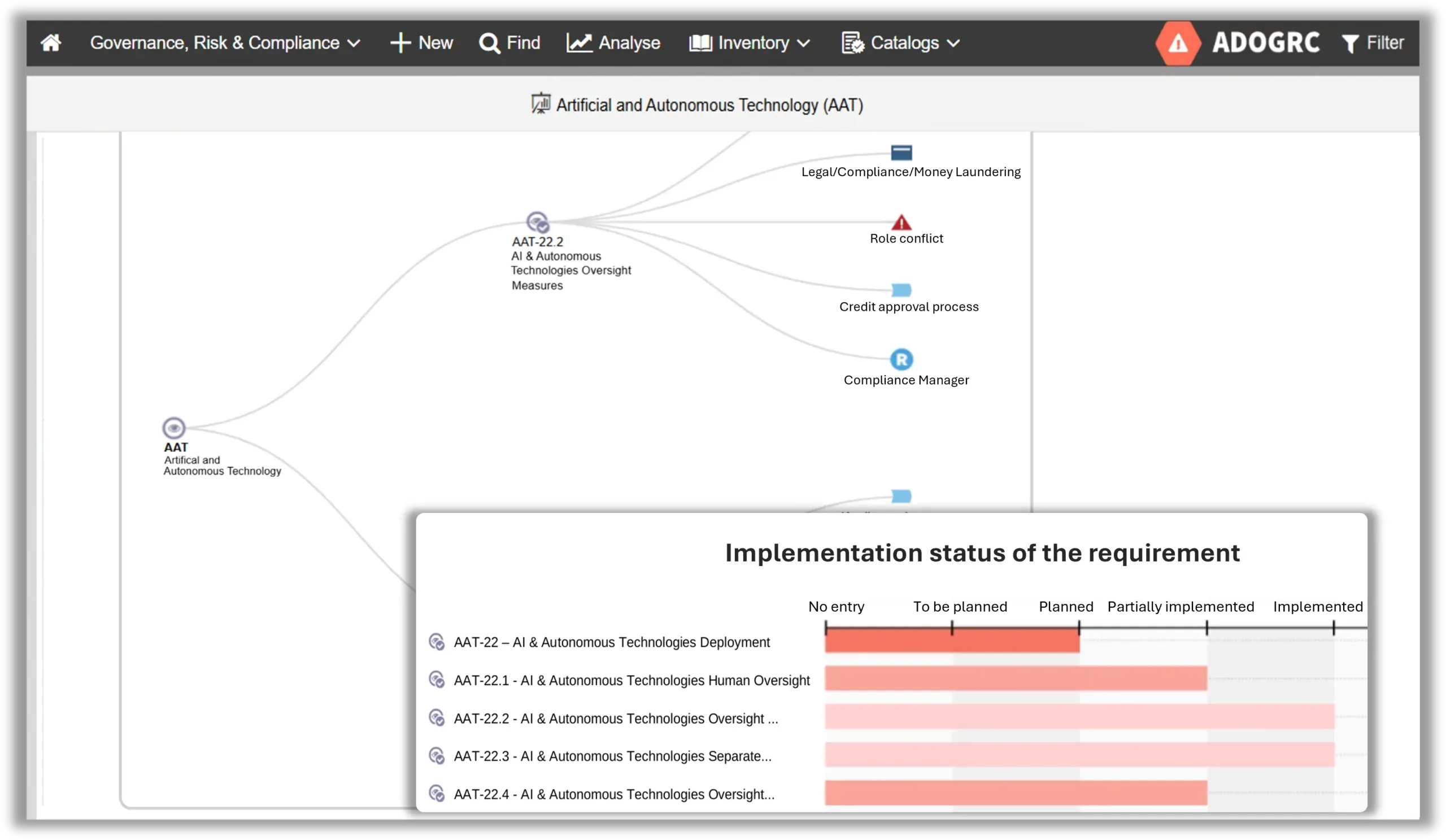

Ancrage de la conformité

Avec ADOGRC, vous intégrez directement la conformité à la loi sur l’IA dans vos processus. Les politiques, responsabilités et points de contrôle sont incorporés aux workflows, transformant la gouvernance d’un document statique en élément actif du quotidien.

Lien direct entre politiques, responsabilités et contrôles avec les processus

Cas pratique : conformité à à la loi sur l’intelligence artificielle dans le service client

Imaginez un scénario typique : une entreprise déploie un assistant IA dans le service client pour traiter les demandes plus efficacement. Comment s’assurer que cet usage respecte les exigences de la loi européenne sur l’intelligence artificielle ? Avec ADOGRC, cela devient possible :

Classifier

L’assistant IA est classé comme risque limité selon la loi européenne sur l’intelligence artificielle, car des obligations de transparence s’appliquent : les utilisateurs doivent être informés qu’ils interagissent avec un système IA.

Évaluer les risques

À partir des exigences identifiées, les données traitées sont examinées pour vérifier la conformité au RGPD, et les fonctionnalités de l’assistant IA sont contrôlées pour s’assurer de leur alignement avec la loi européenne sur l’intelligence artificielle.

Définir et documenter les actions

En plus des contrôles, des actions ponctuelles sont définies, comme la mise à jour de la politique de confidentialité ou l’implémentation d’une fonctionnalité d’information pour l’utilisateur. Toutes les actions sont documentées et versionnées de manière centralisée dans ADOGRC, accessibles à tout moment.

Assurer la traçabilité

Pour les audits internes ou les contrôles externes, ADOGRC fournit des preuves transparentes de toutes les actions, contrôles et responsabilités mises en place.

Le résultat ? Avec ADOGRC, l’innovation reste possible sans prendre de risque réglementaire.

Conclusion : la loi européenne sur l’IA comme opportunité de gouvernance durable

La loi européenne sur l’intelligence artificielle montre clairement que l’intelligence artificielle ne peut atteindre son plein potentiel que lorsqu’elle est gérée de manière responsable. Les organisations qui intègrent une approche GRC solide dans leur stratégie prennent une longueur d’avance. Elles anticipent les risques, transforment les exigences réglementaires en actions concrètes et sécurisent leurs initiatives.

L’IA transforme fondamentalement la manière dont les organisations fonctionnent. Une gouvernance efficace détermine si cette transformation se produit sous la pression réglementaire ou en tant qu’initiative stratégique qui renforce la résilience, la transparence et la compétitivité à long terme.