Hat Ihnen der Artikel weitergeholfen? Dann teilen Sie ihn gerne mit Ihren Kolleg:innen.

Einleitung

Künstliche Intelligenz (KI) hat den Einzug in Unternehmen längst geschafft. Während Chancen enorm sind, wachsen auch die Risiken stetig. Unternehmen sehen sich nun mit Herausforderungen wie intransparenten Entscheidungen, zunehmender Komplexität, Datenschutzproblemen oder regulatorischer Unsicherheit konfrontiert.

Genau hier setzt der EU AI Act an – der weltweit erste umfassende Rechtsrahmen für KI. Seit Juli 2024 in Kraft, mit gestaffelten Übergangsfristen – ab August 2026 greifen die zentralen Pflichten für Unternehmen, die KI-Systeme in der EU entwickeln oder einsetzen. In der Realität betrifft es somit fast jede Organisation.

Machen Sie jetzt den Readiness Check und prüfen Sie, ob Ihre KI-Systeme unter den EU AI Act fallen.

Für Unternehmen bedeutet dies, sich auf klare Vorgaben zu Transparenz, Data-Governance, Risiko-Klassifizierung und Audit-Fähigkeit einzustellen – und gleichzeitig belegen zu können, dass dies sicher, kontrolliert und regelkonform geschieht.

In diesem Blog Post beleuchten wir, wie sich die neue regulatorische Vorgabe EU AI Act in greifbare Prozesse überführen lässt – und wie ADOGRC dabei zum strategischen Werkzeug für AI-Readiness wird.

Warum GRC die Brücke zum AI Act ist

Wenn Unternehmen KI verantwortungsvoll einführen möchten, dann ist es entscheidend, dass Unternehmen KI-Systeme nicht isoliert betrachten, sondern im Rahmen klarer Strukturen. Der AI Act zeigt, dass KI nur dann verantwortungsvoll eingesetzt werden kann, wenn Unternehmen Risiken transparent managen und nachweisen können.

Hier wird deutlich, warum ein stabiles GRC-Fundament unverzichtbar ist:

-

Strukturen für Verantwortung und Kontrolle, die klar regeln, wer für welche Entscheidungen zuständig ist.

-

Verfahren zur Risikobewertung, damit Verzerrungen, intransparente Entscheidungen oder Sicherheitslücken frühzeitig erkannt werden.

-

Verlässliche Dokumentation und Nachweise, die gegenüber Auditor:innen und Stakeholder:innen Bestand haben.

-

Eine Basis für Vertrauen, sodass KI nicht als Blackbox, sondern als nachvollziehbares Werkzeug wahrgenommen wird.

Indem GRC die Anforderungen des AI Acts in konkrete Prozesse, zugehörige Richtlinien, Kontrollen und Maßnahmen übersetzt, nimmt es eine Schlüsselrolle für dessen Einhaltung ein.

Die Kernanforderungen des EU AI Acts

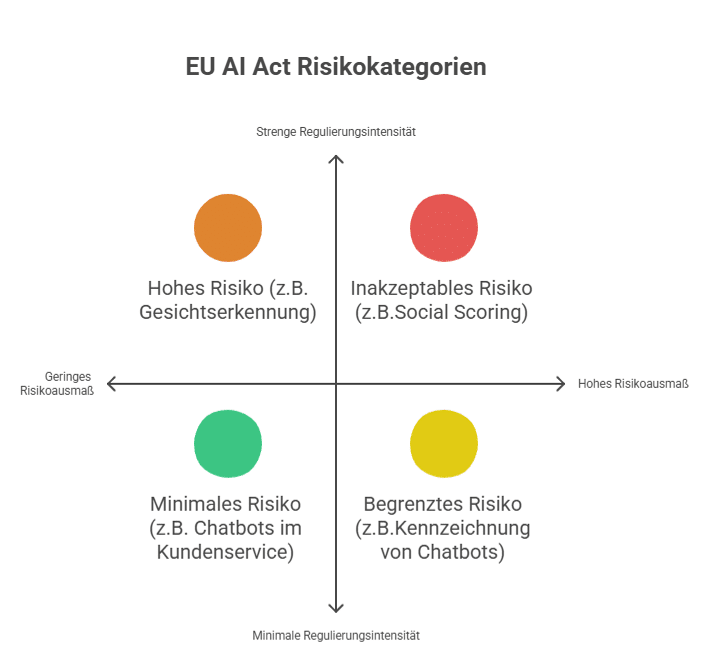

Zur Bewertung der einhergehenden Risiken, ordnet der EU AI Act KI-Systeme in bestimmte Risikokategorien:

- Inakzeptables Risiko: verboten (z. B. Social Scoring).

- Hohes Risiko: strenge Auflagen zu Dokumentation, Datenqualität, menschlicher Aufsicht.

- Begrenztes Risiko: Transparenzpflichten (z. B. Kennzeichnung von Chatbots).

- Minimales Risiko: hier gibt es kaum Vorgaben.

Die EU AI Act Risikokategorien

Besonders relevant für Unternehmen: Hohe-Risiko-KI-Systeme. Hier gelten umfangreiche Pflichten:

- Dokumentation & Nachweis zu Daten, Trainingsprozessen, Entscheidungswegen.

- Transparenz & Erklärbarkeit von Modellen.

- Human Oversight zur Kontrolle kritischer Entscheidungen.

- Audit-Fähigkeit – jederzeit prüfbar und nachvollziehbar.

Die Erfüllung dieser Anforderungen ist ohne strukturierte Governance kaum erfüllbar.

Laut Gartner® (2024) verfügen 57 % der Unternehmen nicht über die nötigen Strukturen und Kontrollmechanismen, um KI sicher einzusetzen. Das heißt: Die Mehrheit ist noch nicht AI-ready – genau hier entsteht Handlungsbedarf.

GRC als Enabler für AI Act Readiness

Eine verantwortungsvolle KI-Nutzung erfordert ein starkes Fundament, das durch GRC geschaffen wird. Die drei GRC-Dimensionen übersetzen sich direkt in AI Act Readiness:

1. Daten-Governance & Schutz

- Herkunft und Qualität von Trainingsdaten sicherstellen und dokumentieren: Denn Unternehmen müssen jederzeit belegen können, woher ihre Daten stammen und ob sie geeignet sind, zuverlässige KI-Modelle zu erzeugen.

- DSGVO- und AI Act-Vorgaben konsistent abbilden: Diese müssen mit Datenqualität und -transparenz im AI Act harmonieren.

2. Risikomanagement & interne Kontrolle

- KI-spezifische Risiken (Bias, Modellversagen, Fehlentscheidungen) identifizieren.

- Kontrollen für Transparenz, Modellvalidierung und Human Oversight implementieren. Denn abgestufte Aufsicht und Monitoring stellen sicher, dass Entscheidungen nachvollziehbar und kontrollierbar bleiben.

3. Compliance & regulatorische Ausrichtung

- Integration von AI Act-Anforderungen mit Standards wie ISO/IEC 42001 oder NIST AI RMF, eingebunden in bestehende Compliance-Frameworks.

- Alle Nachweise, Bewertungen und Maßnahmen werden zentral abgelegt, auditierbar gemacht und dauerhaft nachvollziehbar.

Mit einem GRC-Fundament entsteht ein integriertes Kontrollsystem, das den KI-Einsatz nicht nur rechtskonform macht, sondern auch skalierbar und zuverlässig einsetzbar. Indem Prozesse standardisiert, Verantwortlichkeiten klar definiert und Risiken systematisch gesteuert werden, werden Unternehmen AI-ready.

Tipp: Lesen Sie hier, warum KI-Bereitschaft im GRC verankert ist und es das Fundament für verantwortungsvolle und skalierbare KI bildet.

Von Prinzipien zu Prozessen: Mit ADOGRC den AI Act operationalisieren

Viele Unternehmen haben Leitlinien formuliert – doch häufig fehlen die operativen Modelle, um sie auch durchzusetzen. Genau hier setzt ADOGRC an:

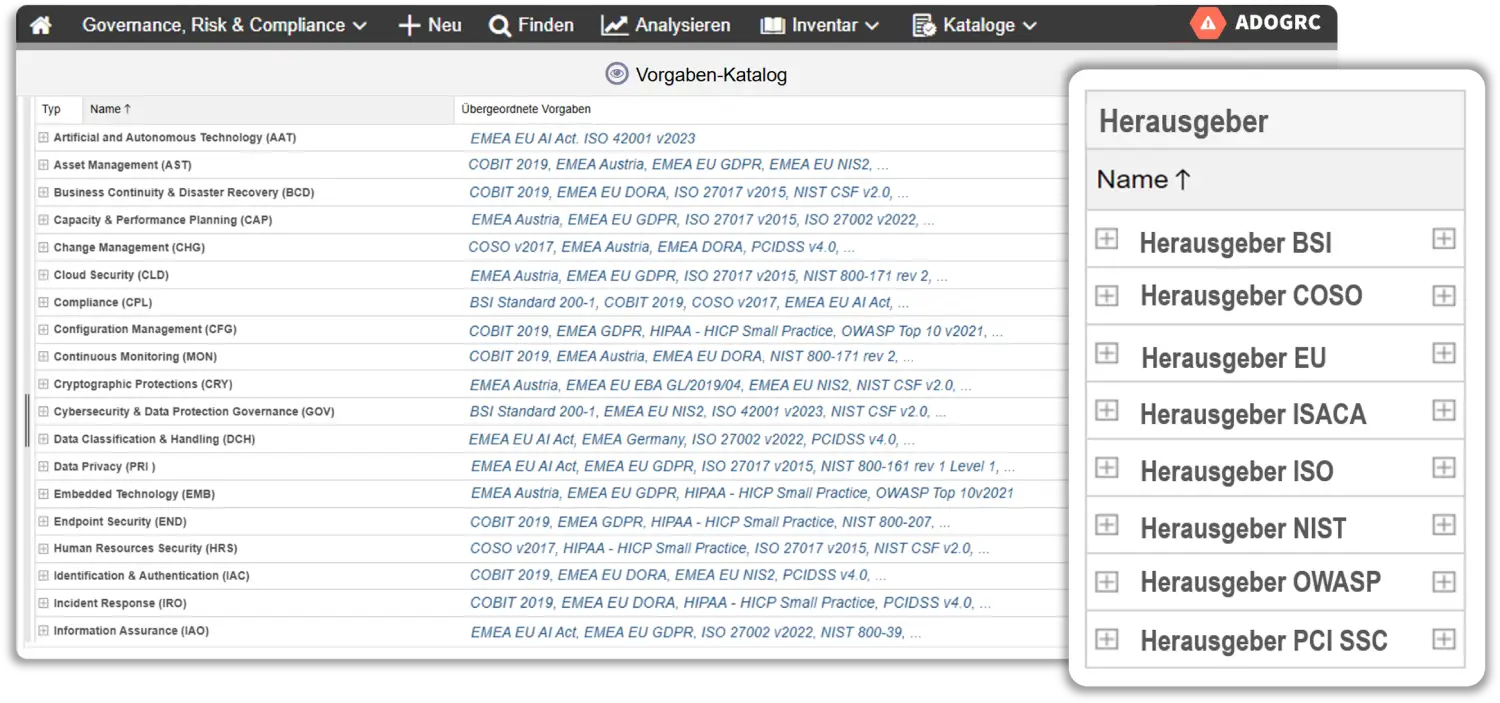

Zentrale Compliance Library

Alle regulatorischen Anforderungen – vom AI Act bis zu branchenspezifischen Normen – werden in ADOGRC zentral erfasst, gepflegt und aktualisiert. So haben Sie eine Single Source of Truth für alle AI-relevanten Verpflichtungen.

ADOGRC’s Compliance Library

Scoping & Relevanzprüfung

Mit ADOGRC filtern Sie heraus, welche Anforderungen des AI Acts und anderer Regularien für Ihr Unternehmen, Ihre KI-Systeme und Use Cases tatsächlich relevant sind. Ihre Risiken lassen sich dabei nicht nur analysieren, sondern auch direkt mit betroffene Prozesse und KI-Anwendungen verknüpfen. Dies sorgt für durchgängige Transparenz in Ihrer Unternehmenslandschaft.

Relevante Vorgaben auf einen Blick

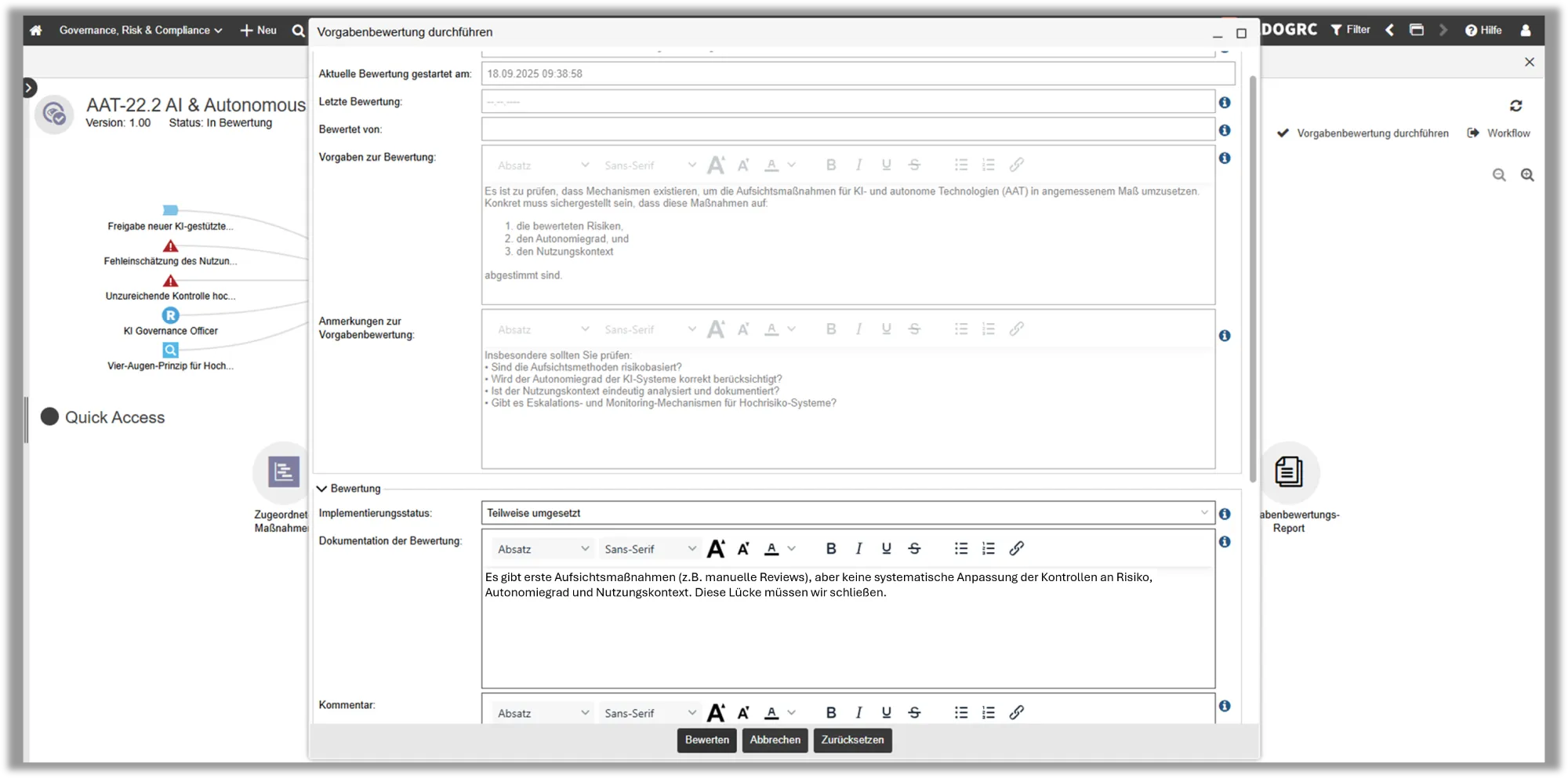

Revisionssichere Bewertung

Mit den standardisierten Bewertungen in ADOGRC überprüfen Sie, ob die Vorgaben des AI Acts eingehalten werden – dokumentiert, nachvollziehbar und auditfest. Detailansichten machen Lücken und Handlungsbedarf sofort sichtbar.

Detailansicht der Vorgabenbewertung

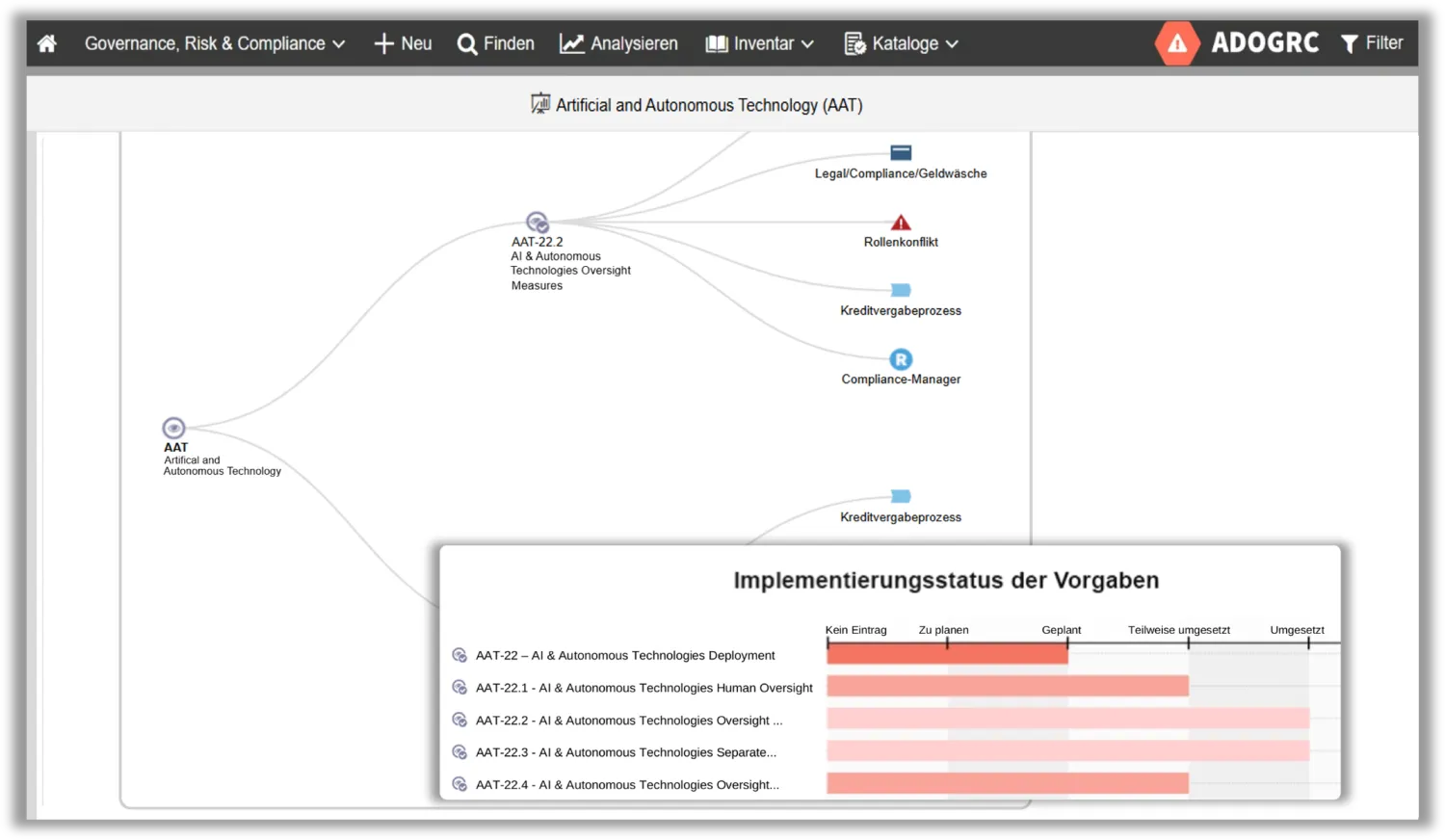

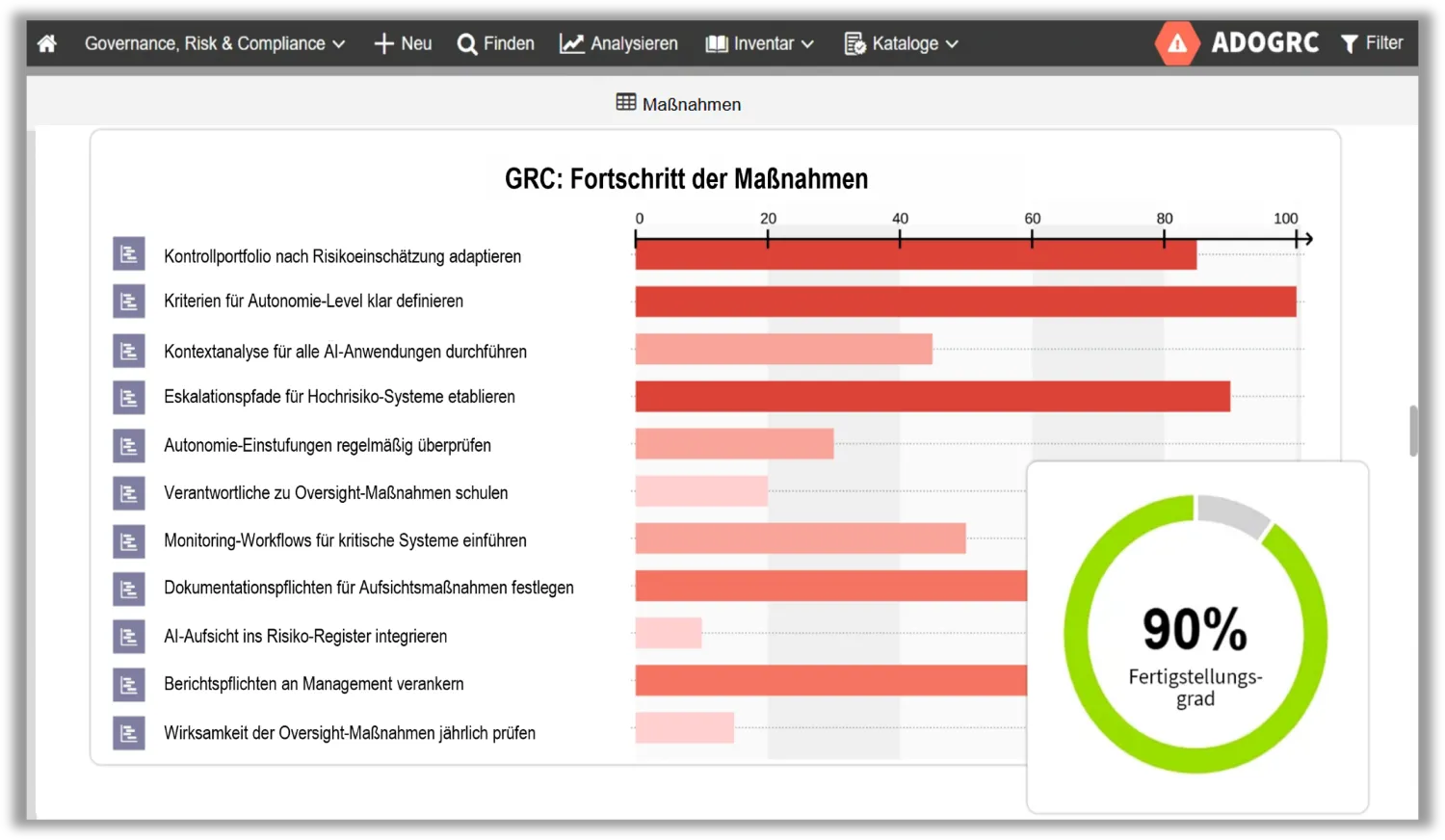

Maßnahmen-Tracking

Ausgehend von der Bewertung Ihrer Vorgaben leiten Sie Maßnahmen direkt in ADOGRC ab. Die Plattform stellt mit automatisierten Workflows sicher, dass Verantwortlichkeiten zugewiesen, Fristen gesetzt und Fortschritte transparent dokumentiert werden. So bleibt kein Schritt im KI-Compliance-Prozess unbeachtet.

Überblick über gesetzte Maßnahmen

Compliance-Anchoring

Mit ADOGRC verankern Sie KI-bezogene Compliance direkt in Ihren Prozessen: Policies, Verantwortlichkeiten und Kontrollpunkte werden direkt in Workflows eingebettet. Damit wird Governance nicht nur ein Dokument, sondern gelebte Praxis im Alltag.

Direkte Verknüpfung von Policies, Verantwortlichkeiten und Kontrollen an Prozessen

Use Case Spotlight: AI Act-Compliance im Kundenservice

Stellen Sie sich ein typisches Beispiel vor: Ein Unternehmen führt einen KI-Assistenten im Kundenservice ein, um Anfragen schneller zu bearbeiten. Doch wie lässt sich sicherstellen, dass dieser Einsatz den Anforderungen des EU AI Acts entspricht? Mit ADOGRC gelingt es:

- Klassifizieren:

Der KI-Assistent wird gemäß AI Act in die Kategorie „Begrenztes Risiko (Limited Risk)“ eingeordnet, da Transparenzpflichten bestehen (Nutzer:innen müssen informiert werden, dass sie mit einer KI interagieren). - Risiken bewerten:

Auf Basis der gescopten Vorgabe werden nun die verarbeiteten Daten auf DSGVO sowie die Funktionsweise des KI-Assistentent auf AI Act-Konformität geprüft. - Maßnahmen erstellen & dokumentieren:

Ergänzend zu Kontrollen werden einmalige Maßnahmen definiert, z. B. die Anpassung der Datenschutzerklärung oder Implementierung einer User-Info-Funktion. Alle Maßnahmen werden zentral in ADOGRC dokumentiert und versioniert – jederzeit abrufbar. - Nachweisbarkeit schaffen:

Für interne Audits oder externe Prüfungen liefert ADOGRC transparente Nachweise über alle umgesetzten Maßnahmen, Kontrollen und Zuständigkeiten.

Das Ergebnis? Mit ADOGRC bleibt Innovation weiterhin möglich, jedoch ohne regulatorisches Risiko.

Fazit: Der AI Act als Chance für nachhaltige KI-Governance

Der EU AI Act macht deutlich, dass Künstliche Intelligenz ihr Potenzial nur dann entfalten kann, wenn sie verantwortungsvoll gesteuert wird. Unternehmen, die ein starkes GRC-Fundament ganzheitlich in ihre Strategie integrieren, erkennen Risiken frühzeitig, operationalisieren Kontrollen und übersetzen regulatorische Anforderungen in konkrete Maßnahmen.

KI verändert die Arbeitsweise von Unternehmen grundlegend. GRC entscheidet, ob diese Transformation unter Druck regulatorischer Vorgaben oder als strategischer Schritt erfolgt, der Organisationen langfristig stärkt.