Te ha resultado útil? Compártelo con tus compañeros.

Introducción

La inteligencia artificial (IA) ya ha encontrado su lugar en las empresas. Las oportunidades son significativas, pero los riesgos siguen creciendo. Muchas organizaciones ahora se enfrentan a problemas con decisiones poco transparentes, creciente complejidad, protección de datos e incertidumbre legal.

La Ley de IA de la UE es la primera ley en Europa que regula la inteligencia artificial. Entró en vigor en julio de 2024. Las principales obligaciones se aplicarán a partir de agosto de 2026 y cubrirán a todas las organizaciones que desarrollen o utilicen sistemas de IA en la UE. En la práctica, eso incluye a casi todas las empresas.

Haz ahora la prueba de preparación y comprueba si tus sistemas de IA se ven afectados por la Ley de IA de la UE.

Las empresas deben garantizar la transparencia en cómo se gestionan los datos y cómo se supervisa la IA. También deben demostrar que sus sistemas funcionan de forma segura y cumplen con los requisitos legales.

Esta entrada de blog explica cómo la Ley de IA de la UE puede convertirse en pasos claros de gobernanza y cómo ADOGRC apoya a las empresas en el desarrollo de la preparación para la IA.

Por qué el GRC es el puente hacia la Ley de IA

Para las organizaciones que buscan introducir la IA de forma responsable, es esencial no analizar los sistemas de IA de manera aislada, sino integrarlos dentro de estructuras claramente definidas. La Ley de IA deja claro que el uso responsable solo es posible cuando las empresas pueden gestionar y demostrar los riesgos de forma transparente.

Esto pone de manifiesto por qué una base sólida de GRC es indispensable:

-

Estructuras de responsabilidad y control que definan claramente quién es responsable de cada decisión.

-

Procedimientos de evaluación de riesgos que identifiquen sesgos, decisiones opacas o brechas de seguridad en una fase temprana.

-

Documentación y evidencias fiables que puedan resistir el escrutinio de auditores y stakeholders.

-

Una base de confianza, garantizando que la IA no se perciba como una caja negra, sino como una herramienta trazable y explicable.

Al traducir los requisitos de la Ley de IA en procesos, políticas, controles y medidas concretas, GRC desempeña un papel central para garantizar el cumplimiento.

Los requisitos clave de la Ley de IA de la UE

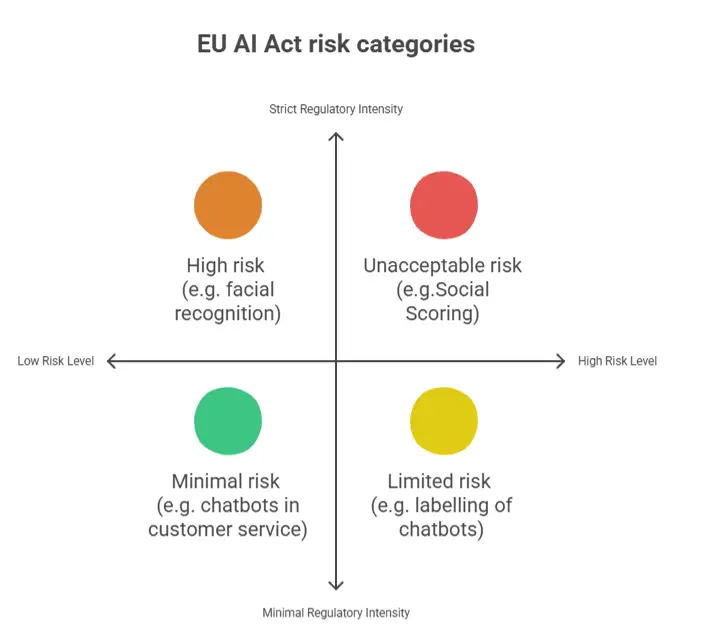

Las categorías de riesgo de la Ley de IA de la UE

Estos sistemas conllevan obligaciones amplias y exigentes:

- Documentación y evidencias completas que cubran datos, procesos de entrenamiento y rutas de decisión.

- Transparencia y explicabilidad de los modelos.

- Supervisión humana para monitorizar y controlar decisiones críticas.

- Auditabilidad, garantizando que los sistemas puedan revisarse y trazarse en cualquier momento.

Cumplir con estos requisitos es prácticamente imposible sin una estructura de gobernanza sólida.

Según Gartner® (2024), el 57 % de las organizaciones carece de las estructuras y mecanismos de control necesarios para desplegar la IA de forma segura. En otras palabras, la mayoría aún no está preparada para la IA, lo que convierte la acción en una prioridad inmediata.

GRC como facilitador de la preparación para la Ley de IA

El uso responsable de la IA requiere una base sólida — y esa base la proporciona GRC. Sus tres dimensiones principales se traducen directamente en preparación para la Ley de IA:

1. Gobernanza y protección de datos

- Garantizar y documentar el origen y la calidad de los datos de entrenamiento. Las organizaciones deben poder demostrar en todo momento de dónde proceden sus datos y si son adecuados para construir modelos de IA fiables.

- Alinear de forma coherente los requisitos del RGPD y la Ley de IA, armonizándolos con los principios de calidad de datos y transparencia.

2. Gestión de riesgos y control interno

- Identificar riesgos específicos de la IA, como sesgos, fallos del modelo o decisiones incorrectas.

- Implementar controles de transparencia, validación de modelos y supervisión humana. Un enfoque estructurado de monitorización garantiza que las decisiones sigan siendo explicables y gestionables.

3. Cumplimiento y alineación regulatoria

- Integrar los requisitos de la Ley de IA con estándares como ISO/IEC 42001 o el NIST AI RMF, incorporándolos en los marcos de cumplimiento existentes.

- Centralizar todas las evidencias, evaluaciones y medidas para asegurar auditabilidad y trazabilidad a largo plazo.

Con una base sólida de GRC, las organizaciones establecen un sistema de control integrado que hace que el despliegue de la IA no solo sea conforme a la normativa, sino también escalable y fiable. Al estandarizar procesos, definir responsabilidades y gestionar riesgos de forma sistemática, la organización se convierte en verdaderamente AI-ready.

Consejo: Descubre por qué la preparación para la IA tiene su raíz en GRC y cómo constituye la base para una IA responsable y escalable.

De los principios a los procesos: cómo operacionalizar la Ley de IA con ADOGRC

Muchas organizaciones ya han definido sus directrices de IA, pero a menudo carecen de los modelos operativos necesarios para aplicarlas de forma efectiva. Aquí es donde entra en juego ADOGRC.

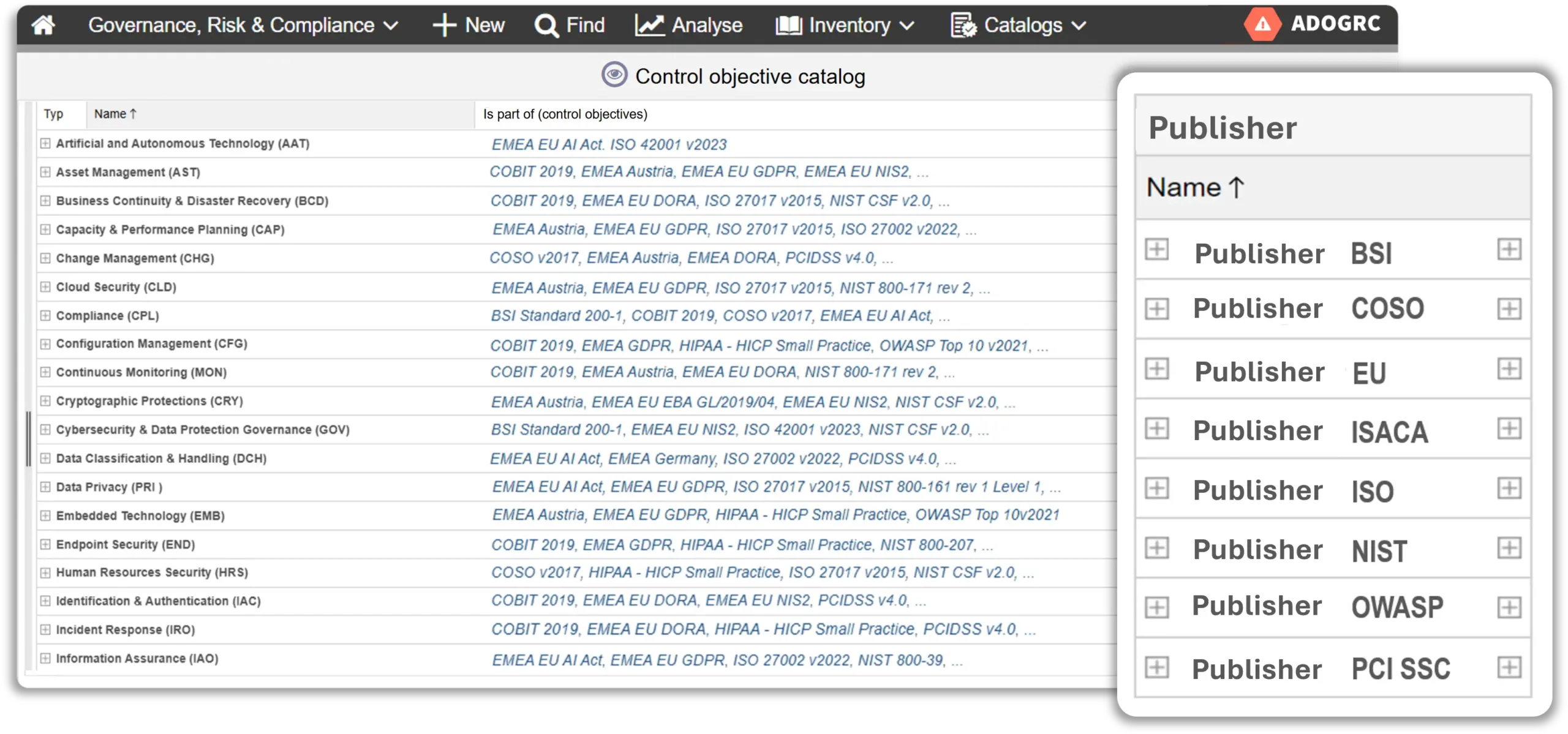

Biblioteca centralizada de cumplimiento

Todos los requisitos regulatorios — desde la Ley de IA hasta normativas específicas del sector — se registran, gestionan y actualizan de forma centralizada en ADOGRC.

La biblioteca de cumplimiento de ADOGRC

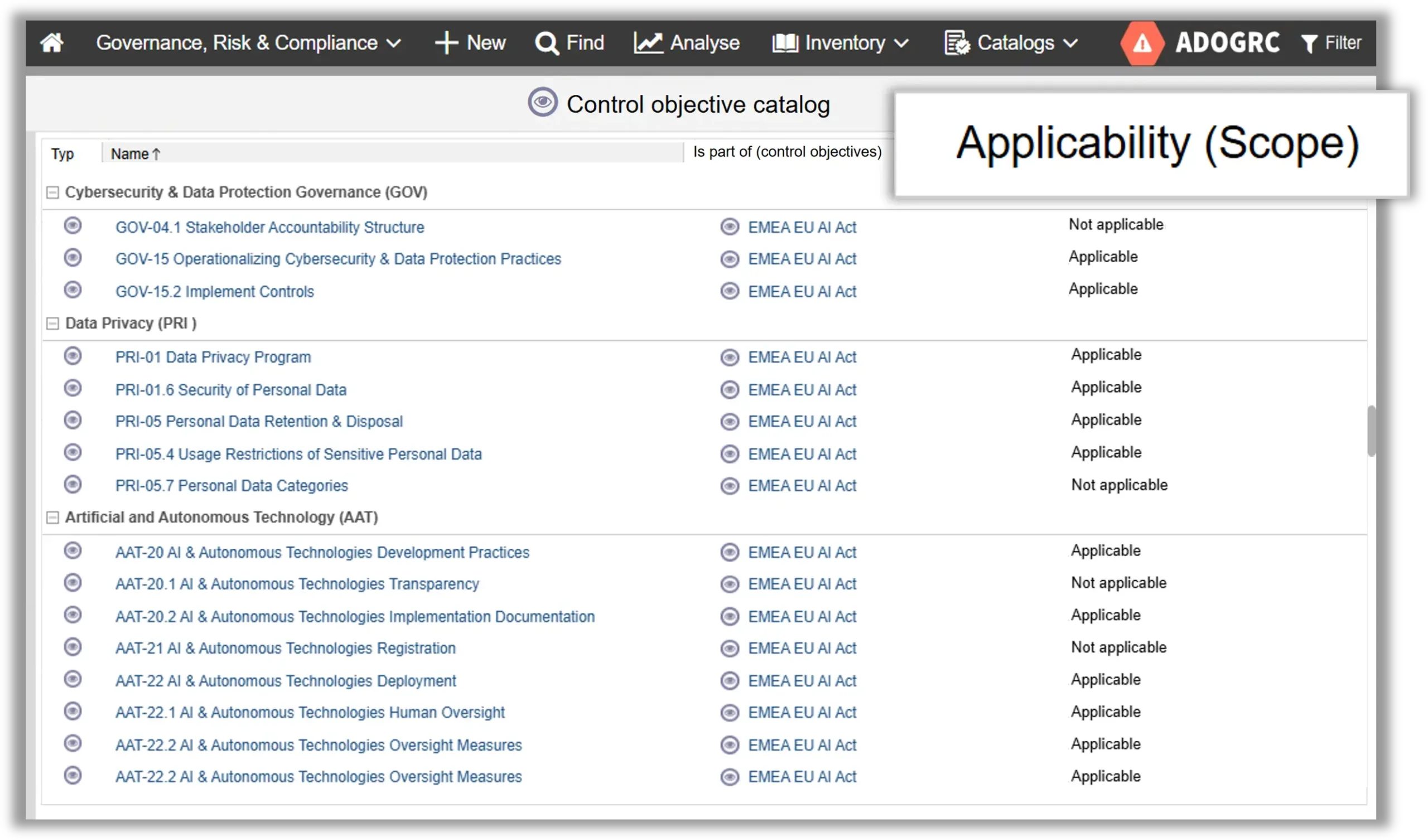

Definición de alcance y evaluación de relevancia

Requisitos relevantes de un vistazo

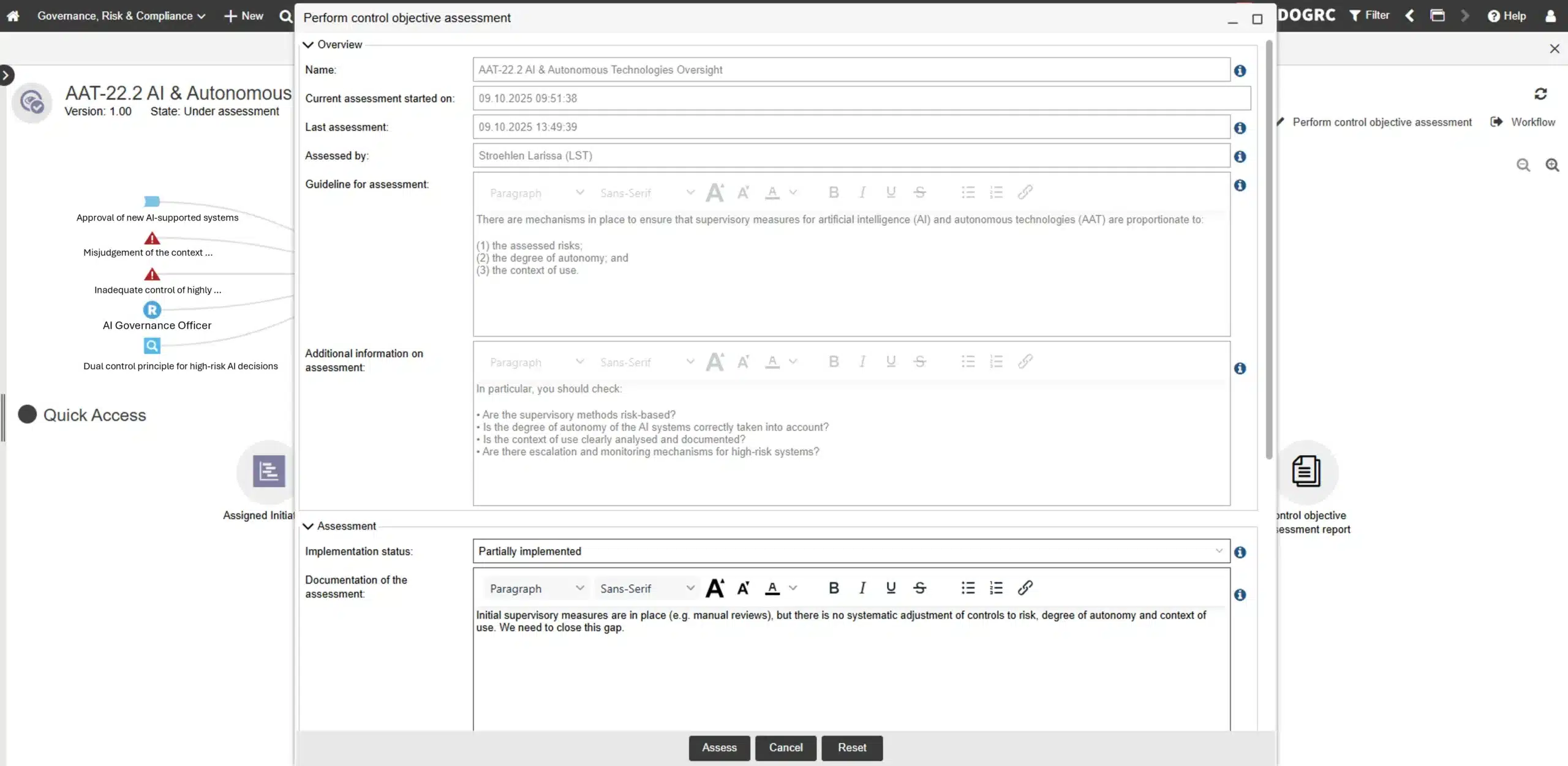

Evaluación preparada para auditoría

Con las evaluaciones estandarizadas de ADOGRC, puedes verificar si se están cumpliendo los requisitos de la Ley de IA — de forma documentada, trazable y preparada para auditoría.

Vista detallada de la evaluación de requisitos

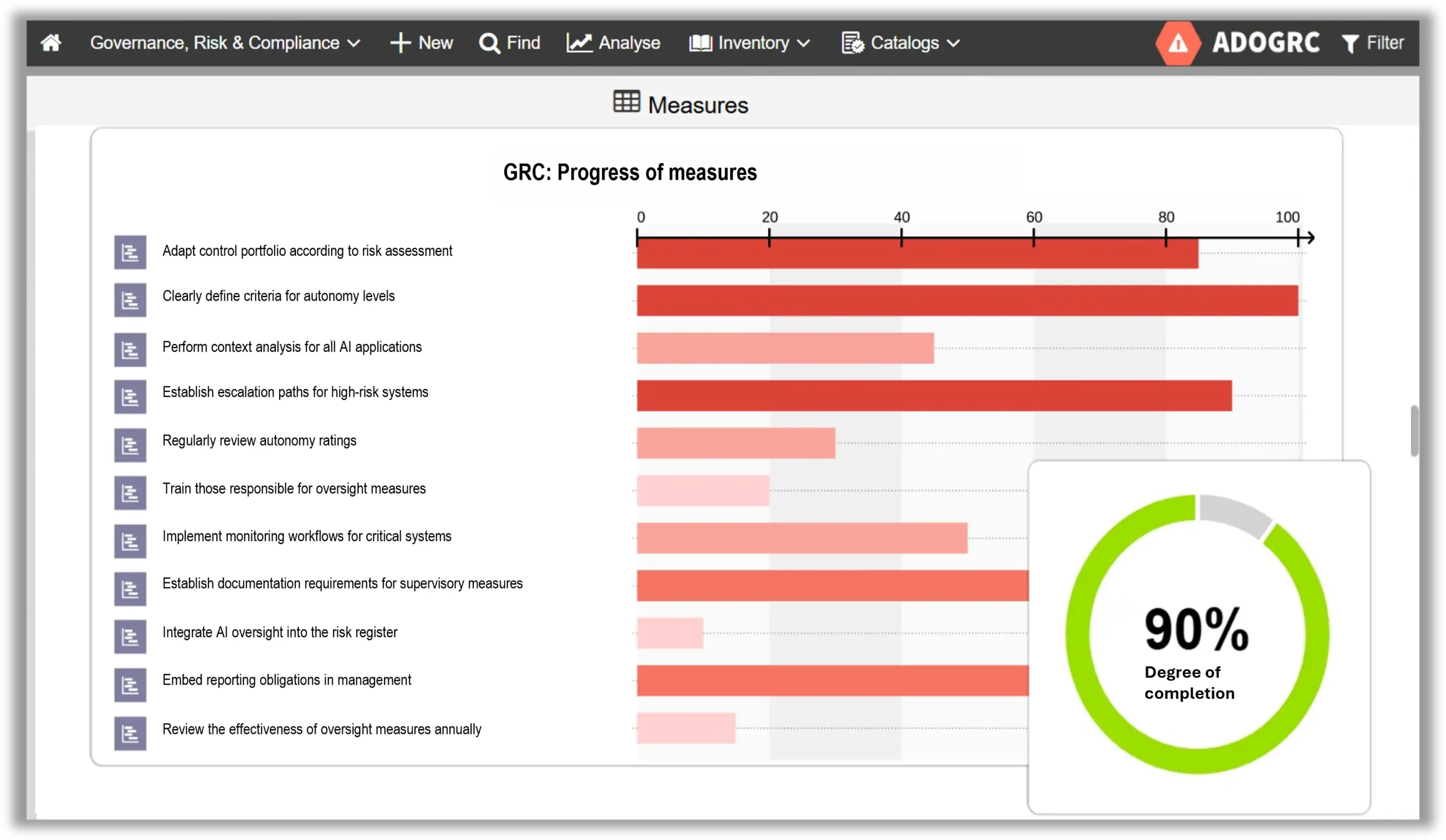

Seguimiento de acciones

A partir de la evaluación de requisitos, puedes definir y gestionar acciones directamente en ADOGRC. La plataforma garantiza, mediante flujos de trabajo automatizados, que se asignen responsabilidades, se establezcan plazos y se documente el progreso de forma transparente. Así, ningún paso del proceso de cumplimiento en materia de IA pasa desapercibido.

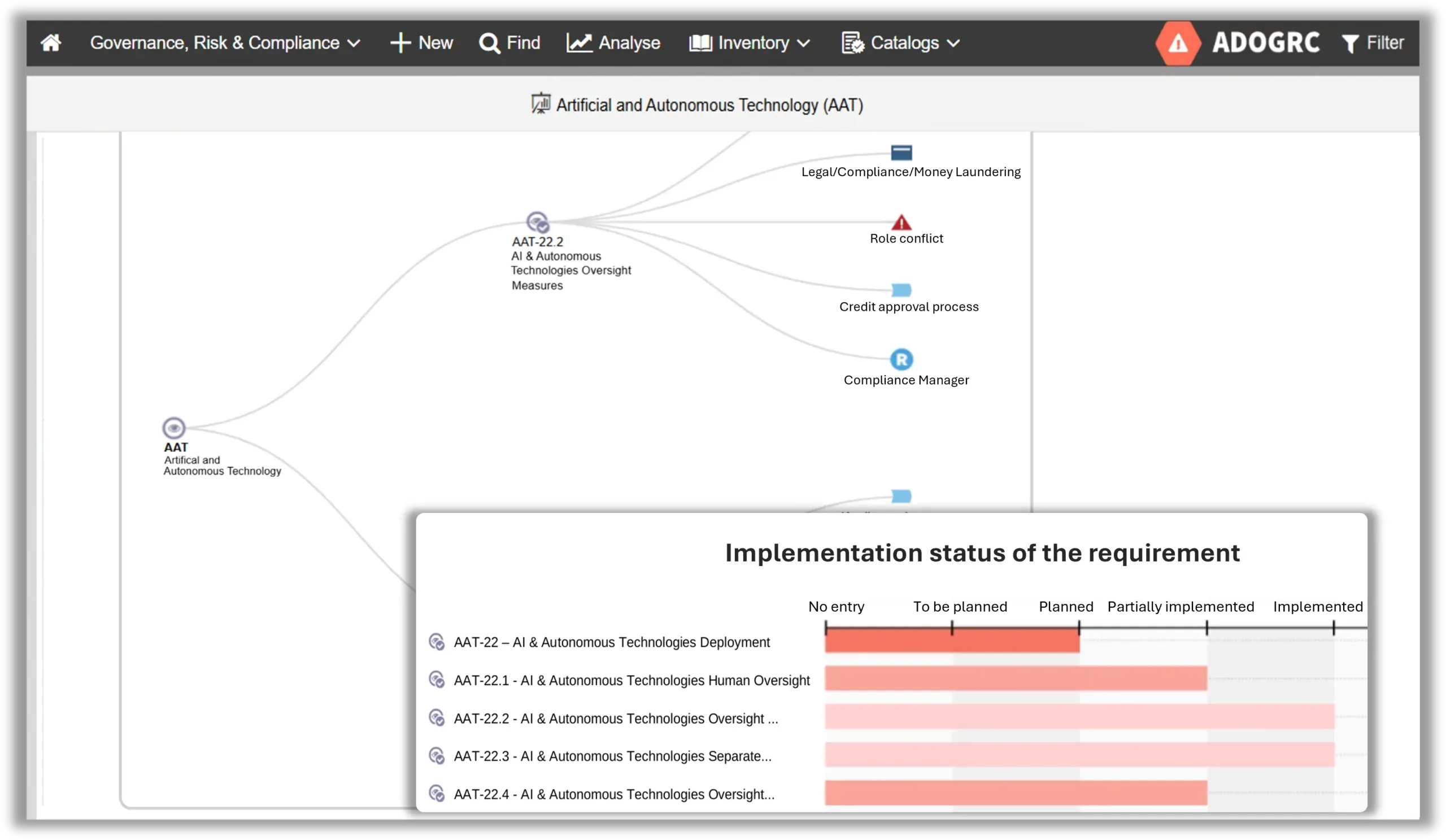

Integración del cumplimiento

Con ADOGRC, integras el cumplimiento relacionado con la IA directamente en tus procesos. Las políticas, responsabilidades y puntos de control se incorporan en los flujos de trabajo, transformando la gobernanza de un documento estático en una parte activa del día a día.

Vinculación directa de políticas, responsabilidades y controles con los procesos

Caso práctico destacado: Cumplimiento de la Ley de IA en Atención al Cliente

Imagina un escenario habitual: una empresa implementa un asistente de IA en atención al cliente para gestionar consultas de forma más eficiente. Pero ¿cómo puede asegurarse de que este uso cumple con los requisitos de la Ley de IA de la UE? Con ADOGRC, es posible:

Clasificar

El asistente de IA se categoriza como de riesgo limitado según la Ley de IA, ya que se aplican obligaciones de transparencia: los usuarios deben ser informados de que están interactuando con un sistema de IA.

Evaluar riesgos

En función de los requisitos definidos en el alcance, se revisan los datos tratados para garantizar el cumplimiento del RGPD y se analiza la funcionalidad del asistente para verificar su alineación con la Ley de IA.

Definir y documentar acciones

Además de establecer controles, se definen acciones puntuales, como actualizar la política de privacidad o implementar un aviso informativo para el usuario. Todas las acciones se documentan y versionan de forma centralizada en ADOGRC, con acceso en cualquier momento.

Garantizar la trazabilidad

Para auditorías internas o revisiones externas, ADOGRC proporciona evidencias transparentes de todas las acciones, controles y responsabilidades implementadas.

¿El resultado? Con ADOGRC, la innovación sigue siendo posible, pero sin riesgos regulatorios.

Conclusión: La Ley de IA como oportunidad para una gobernanza sostenible de la IA

La Ley de IA de la UE deja claro que la inteligencia artificial solo puede desplegar todo su potencial cuando se gestiona de forma responsable. Las organizaciones que integran una base sólida de GRC de manera transversal en su estrategia pueden identificar riesgos de forma temprana, operacionalizar controles y transformar los requisitos regulatorios en acciones concretas.

La IA está redefiniendo la forma en que operan las organizaciones. GRC es el factor que determina si esta transformación ocurre bajo presión regulatoria o como un movimiento estratégico que fortalece a la empresa a largo plazo.