Hat Ihnen der Artikel weitergeholfen? Dann teilen Sie ihn gerne mit Ihren Kolleg:innen.

Einleitung

Die aktuelle Diskussion rund um agentische KI (Agentic AI) in der Prozessautomatisierung bewegt sich an einer unangenehmen Schnittstelle zwischen Ambition und Realität.

Auf der einen Seite wird Unternehmen versprochen, dass autonome Systeme komplexe Aufgaben systemübergreifend planen, entscheiden und ausführen können. Auf der anderen Seite erwarten Analysten, dass bis 2027 mehr als 40 % der heutigen Projekte mit agentischer KI aufgrund von Kosten, Skalierungskomplexität oder unkontrollierten Risiken eingestellt werden könnten. Diese Spannung ist deshalb so relevant, weil agentische KI einen strukturellen Wandel im Geschäftsprozessmanagement darstellt.

Traditionelle Prozessautomatisierung folgt vordefinierten Abläufen. Sie führt genau das aus, was zuvor definiert wurde – nicht mehr und nicht weniger. Agentische Systeme funktionieren anders: Sie verfolgen Ziele, interpretieren Kontext und entscheiden selbst, wie ein Ergebnis erreicht werden kann. Der Wechsel von regelbasierter Ausführung hin zu zielorientiertem Handeln schafft enorme Chancen – bringt aber auch strukturelle Risiken mit sich.

Die Frage ist daher nicht, ob agentische KI in Unternehmen Einzug halten wird. Die entscheidende Frage ist, ob es Organisationen gelingt, diese Technologie in kontrollierte Prozessarchitekturen einzubetten, die Autonomie ermöglichen, ohne die notwendige Kontrolle zu verlieren.

Warum agentische KI die traditionelle Prozessautomatisierung herausfordert

Ein verbreitetes Missverständnis besteht darin, „Agentische KI“ als einzelne Fähigkeit zu betrachten. In Wirklichkeit basiert sie auf Large Language Models (LLMs), einem Teilbereich der Generativen KI. LLMs können Sprache verstehen, Inhalte generieren und Schlussfolgerungen unterstützen. Für sich genommen sind sie jedoch passiv – sie reagieren auf Eingaben, handeln aber nicht eigenständig.

In den vergangenen Jahren lag der Fokus vieler Organisationen darauf, LLMs im Unternehmenskontext nutzbarer zu machen: durch Zugriff auf operatives Wissen, ein besseres Kontextverständnis und die Fähigkeit, „die Sprache des Unternehmens“ zu sprechen. Modelle wurden trainiert oder konfiguriert, interne Terminologie, Prozesse und Dokumentationen zu verstehen, um Mitarbeitende effektiver zu unterstützen. Doch nun verschiebt sich die Zielsetzung.

Wir bitten KI nicht mehr nur um Unterstützung. Wir definieren Ziele, weisen Verantwortlichkeiten zu und legen fest, welche Aktionen erlaubt sind. Mit anderen Worten: Wir verwandeln Sprachmodelle in Agenten, die innerhalb von Unternehmens-Workflows eigenständig Ziele verfolgen können.

Dialogfähiger KI-Agent

Vom Sprachmodell zum autonomen Agenten

Damit aus einem LLM ein KI-Agent werden kann, muss es um zusätzliche Fähigkeiten erweitert werden:

Wahrnehmung und Zieldefinition – Zugriff auf relevante Informationen aus der Umgebung und Ableitung eines Ziels

Schlussfolgern und Planung – Zerlegung komplexer Ziele in strukturierte Schritte

Autonomie und Handlung – Auswahl von Tools und Ausführung von Aktionen ohne permanente menschliche Steuerung

Sobald ein Agent gestartet wird, kann er selbst bestimmen, was als nächstes zu tun ist und welche Systeme oder Tools aufgerufen werden müssen – beispielsweise das Abrufen von Leads aus einem CRM-System oder das Starten einer Compliance-Prüfung. Dieser Wandel macht aus Sprachmodellen nicht mehr nur Assistenten, sondern zielgesteuerte Akteure innerhalb von Unternehmens-Workflows.

Das Versprechen ist überzeugend: KI-gesteuerte digitale Mitarbeitende, die kontinuierlich arbeiten, Geschäftsziele verstehen, auf Unternehmenssysteme zugreifen und Aufgaben mit minimaler Aufsicht ausführen. Doch mit größerer Autonomie steigt auch die Verantwortung.

Je mehr Entscheidungsbefugnisse an KI-Agenten übertragen werden, desto wichtiger werden Klarheit, Nachvollziehbarkeit und Verantwortlichkeit in ihrer Arbeitsumgebung. Ohne klar definierte Prozessgrenzen kann das Verhalten von Agenten intransparent werden – eine „Black Box“, die Entscheidungen trifft, die sich nur schwer erklären, prüfen oder mit den vorgesehenen Prozessabläufen in Einklang bringen lassen.

Und genau deshalb stellt agentische KI die traditionelle Prozessautomatisierung vor neue Herausforderungen.

Was ist agentische KI in der Prozessautomatisierung?

Im Kern bedeutet agentische KI in der Prozessautomatisierung, autonome KI-Agenten in klar definierte Geschäftsprozesse einzubetten. Sie kombiniert zielorientiertes Handeln mit eindeutig festgelegten Grenzen.

Traditionelle Automatisierung führt nur das aus, was explizit definiert wurde. Jeder Schritt, jede Regel und jeder Entscheidungszweig muss im Voraus festgelegt sein, damit das System handeln kann.

Agentische Systeme hingegen arbeiten auf ein definiertes Ziel hin. Sie können Kontext interpretieren, Tools auswählen und die Abfolge von Aktionen bestimmen, die zur Zielerreichung notwendig sind – innerhalb genehmigter Grenzen. Autonomie bedeutet jedoch nicht den Verzicht auf Kontrolle.

Damit agentische Automatisierung in Unternehmensumgebungen funktioniert, müssen zentrale Elemente im Voraus festgelegt werden: das Prozessziel, die zur Zielerreichung erforderlichen Aufgaben, die Datenquellen, auf die ein Agent zugreifen darf, die Aktionen, die er ausführen darf, sowie die Punkte, an denen menschliche Freigaben oder Eskalationen erforderlich sind.

Ohne Grenzen schafft Autonomie Unsicherheit. Mit bewusstem Prozessdesign wird sie skalierbar.

Wie agentische KI die Prozessautomatisierung verändert

Die Einführung von KI-Agenten in Workflows macht Prozessdesign nicht überflüssig – aber sie verändert, was Prozessdesign berücksichtigen muss.

Traditionell wurden Prozesse entweder für die Ausführung durch Menschen beschrieben, bei denen Erfahrung Lücken füllt, oder für statische Regel-Engines, bei denen jede Bedingung explizit modelliert werden muss. Agentische Automatisierung verändert die Art der Ausführung, indem sie autonomes Schlussfolgern innerhalb definierter Grenzen ermöglicht.

Die Struktur bleibt dabei weiterhin klar definiert. Ziele, Einschränkungen, Eskalationspfade und verfügbare Tools werden nach wie vor im Prozessmodell festgelegt. Doch die Entscheidungslogik innerhalb von Aufgaben ist nicht mehr vollständig fest programmiert. Anstatt einen festen Entscheidungsbaum auszuführen, interpretiert der Agent den Kontext, bewertet relevante Daten und entscheidet, wie das Ziel innerhalb der definierten Grenzen erreicht werden kann.

Der Prozess definiert weiterhin, was erlaubt ist. Der Agent entscheidet, wie er sich innerhalb dieses Rahmens bewegt.

Das schafft kontrollierte Flexibilität. Die Ausführung kann sich an den situativen Kontext anpassen, ohne die Governance zu verlassen. Entsprechend verändern sich auch die Rollen von Menschen: weg von der Überwachung jedes einzelnen operativen Schritts hin zur Steuerung von Ausnahmen, Freigaben und Performance.

Gleichzeitig wird Transparenz noch wichtiger. Wenn Entscheidungen situationsabhängig getroffen werden, müssen sie dennoch nachvollziehbar und überprüfbar bleiben.

Die Ausführung wird anpassungsfähiger – aber auch anspruchsvoller in der Steuerung.

Die Risiken unkontrollierter agentischer Automatisierung

Ohne definierte Grenzen wird aus Anpassungsfähigkeit schnell ein Risiko. Wenn GenAI-Agenten ohne klare Prozess-Governance arbeiten, entstehen strukturelle Risiken – nicht, weil der Technologie Intelligenz fehlt, sondern weil Autonomie ohne Begrenzung stattfindet.

Inkonsistente Ergebnisse

Agenten können dieselben Informationen unterschiedlich interpretieren, unterschiedliche Tools für dieselbe Aufgabe verwenden oder auf unvollständige bzw. falsche Datenquellen zugreifen. Das kann zu inkonsistenten oder falschen Ergebnissen in vergleichbaren Fällen führen.

Uneingeschränkte Autonomie

Bei der Verfolgung eines Ziels können Agenten zu viele Aktionen ausführen – etwa unnötige Tools auswählen, unbeabsichtigte Prozesspfade verfolgen oder Maßnahmen ergreifen, nur weil sie technisch möglich sind.

Unklare Verantwortlichkeiten

Agenten können scheinbar sichere Entscheidungen auf Basis schwacher Annahmen, veralteter Informationen oder Fehlwahrnehmungen treffen, die durch zu viel Kontext entstehen. Je stärker die Ausführung automatisiert wird, desto schwieriger wird es, Verantwortlichkeiten nachzuvollziehen.

Unverantwortlicher Umgang mit Daten

Agenten können falsche Datenquellen nutzen, Datensensibilität nicht erkennen, wenn Informationen kombiniert werden, oder falsche Schlussfolgerungen ziehen, wenn sie mit zu vielen oder unstrukturierten Informationen konfrontiert sind.

Steigende operative Risiken

Da Agenten kontinuierlich und mit maschineller Geschwindigkeit arbeiten, können sich Fehlinterpretationen oder falsche Tool-Entscheidungen schnell über vernetzte Systeme ausbreiten. Werden diese nicht rechtzeitig erkannt und behoben, können kleine Fehler zu größeren operativen Störungen eskalieren.

Diese Herausforderungen erklären, warum viele GenAI-Initiativen Schwierigkeiten haben, den Schritt von kontrollierten Pilotprojekten hin zum unternehmensweiten Einsatz zu schaffen. Der begrenzende Faktor ist selten die Intelligenz selbst – sondern das Fehlen von Governance rund um ihren Einsatz. Der Erfolg hängt davon ab, Autonomie sowohl in die Prozessarchitektur als auch in die übergeordnete Enterprise Architecture Management einzubetten, anstatt KI als isolierte Einzellösung zu betrachten.

Warum Prozess-Governance entscheidend wird

Autonomie allein reicht nicht aus. Sie muss in eine klar definierte Prozess-Governance eingebettet werden.

Zuverlässige Ergebnisse

Klare Ziele, definierte Aufgabenlogik und eindeutige Erfolgskriterien lenken das Verhalten von Agenten in Richtung der gewünschten Geschäftsergebnisse.

Sichere Autonomie

Prozessmodelle definieren, wo eigenständiges Handeln erlaubt ist und wo menschliche Eskalation erforderlich wird.

Nachvollziehbare Entscheidungen

Klare Rollenverantwortlichkeiten und definierte Freigabepunkte stellen sicher, dass Verantwortung erhalten bleibt, auch wenn die Ausführung automatisiert erfolgt.

Verantwortungsvoller Umgang mit Daten

Governance-Richtlinien legen fest, auf welche Datenquellen zugegriffen werden darf und wie Informationen innerhalb eines Workflows kombiniert werden dürfen.

Operative Stabilität

Monitoring und Analysen machen adaptives Verhalten sichtbar, sodass Abweichungen frühzeitig erkannt und korrigiert werden können.

Lebenszyklusgetriebene Weiterentwicklung

Die Einbettung von Agenten in den gesamten Prozessmanagement-Lebenszyklus – von Design und Analyse über Ausführung und Monitoring bis hin zur kontinuierlichen Optimierung – stellt sicher, dass Autonomie langfristig mit den Unternehmenszielen im Einklang bleibt.

In der Praxis kombinieren Plattformen wie ADONIS KI-gestützte Modellierung und Analyse mit transparenter Lebenszyklus-Governance – und schaffen so die Grundlage für agentische Automatisierung auf Unternehmensebene.

Wie ein Geschäftsprozess im Jahr 2026 aussehen könnte

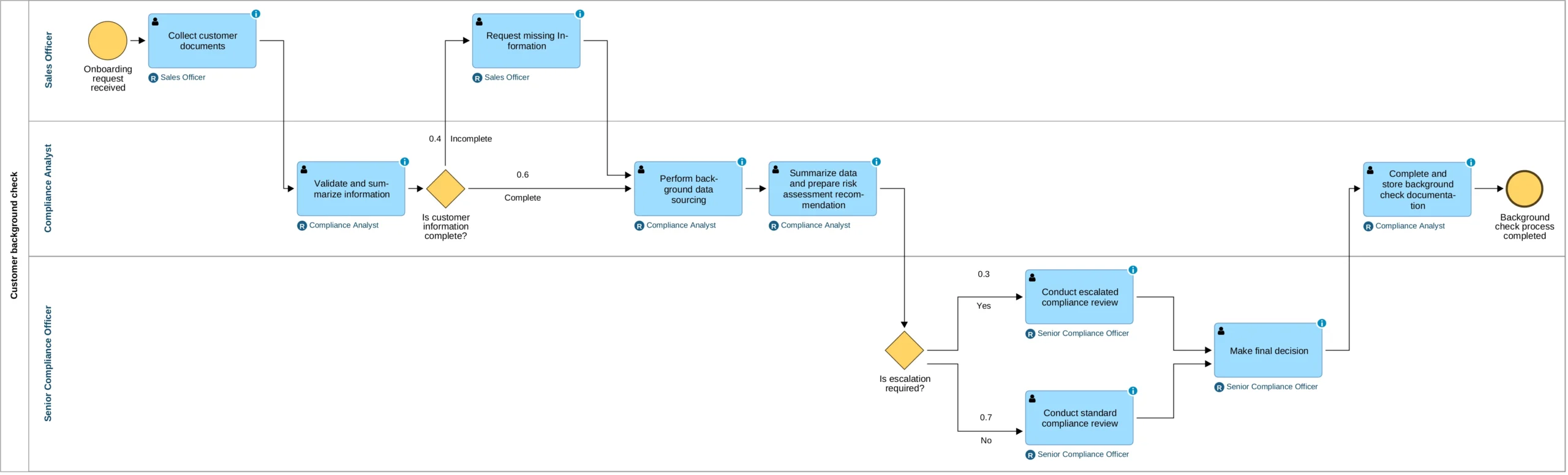

Um die praktische Auswirkung von agentischer KI in der Prozessautomatisierung zu veranschaulichen, betrachten wir einen Background-Check-Prozess in einer regulierten Branche wie beispielsweise Finanzdienstleistungen.

Drei Rollen sind beteiligt:

- Ein Sales Officer sammelt die Unterlagen

- Ein Compliance Analyst führt die Analyse durch und erstellt eine Risikozusammenfassung

- Ein Senior Compliance Officer trifft die finale Entscheidung

ADONIS Geschäftsprozessdiagramm: Background-Check eines Kunden

Die Art der Tätigkeit von Compliance Analyst:innen eignet sich besonders gut für eine strukturierte agentische Automatisierung. Zu diesen Aufgaben gehören:

- Informationen validieren und zusammenfassen

- Hintergrundrecherchen und Datensammlung durchführen

- Daten zusammenfassen und eine Empfehlung für die Risikobewertung erstellen

- Background-Check-Dokumentation vervollständigen und speichern

Alle diese Schritte unterstützen die finale Entscheidung, treffen sie jedoch nicht selbst. Die endgültige Verantwortung bleibt beim Senior Compliance Officer. Wenn der Prozess mit der ADONIS Prozesssimulation modelliert und simuliert wird, wird der Einfluss messbar statt nur hypothetisch.

Die Simulation vergleicht den traditionellen Ablauf mit einem Szenario, in dem ein KI-Agent die Aufgaben von Analyst:innen übernimmt.

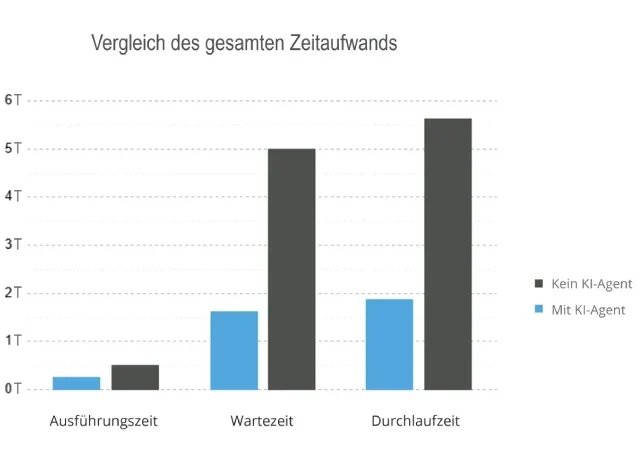

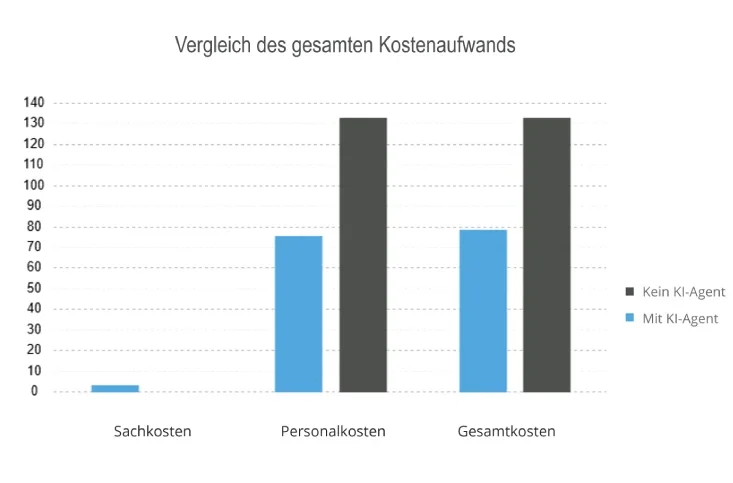

Gesamter Arbeitszeit- und Kostenaufwand

Die Ergebnisse zeigen messbare Verbesserungen:

-

Ausführungszeit um 55% reduziert

-

Wartezeit um 80% reduziert

-

Personalkosten um 43% reduziert

Die Durchlaufzeit sinkt, weil vorbereitende Arbeiten nicht mehr von manueller Verfügbarkeit abhängen. Kosteneinsparungen entstehen, weil menschliche Arbeit stärker auf höherwertige Tätigkeiten wie Kontrolle und Entscheidungsfindung verlagert wird – doch der Effekt geht über reine Kostensenkung hinaus.

Durch die Verlagerung repetitiver Vorbereitungsarbeiten auf KI-Agenten erhöhen Unternehmen ihre operative Kapazität, ohne den Personalstand proportional erhöhen zu müssen. Das ermöglicht skalierbares Wachstum, bessere Margen und schnellere Reaktionszeiten bei steigender Nachfrage. Am wichtigsten ist jedoch: Die Verantwortung für die finale Entscheidung bleibt unverändert beim Menschen.

Dieses Beispiel zeigt, wie agentische KI in der Prozessautomatisierung aussieht, wenn sie in strukturierte Prozess-Governance eingebettet ist: GenAI arbeitet innerhalb klar definierter Grenzen, mit messbarem Nutzen und klar geregelter Verantwortung.

Das ist keine unkontrollierte Automatisierung. Es ist strukturierte, simulierte und kontrollierte Erweiterung menschlicher Arbeit.

Ist agentische KI in der Prozessautomatisierung die Zukunft?

Agentische KI hält bereits Einzug in Unternehmens-Workflows. Die entscheidende Frage ist nicht, ob Unternehmen sie einsetzen werden, sondern ob ihre Workflows auf GPM-Prinzipien basieren, die skalierbare und gesteuerte Automatisierung ermöglichen.

Dort, wo Prozesse klar modelliert sind, Grenzen definiert wurden und Verantwortlichkeiten eindeutig geregelt sind, kann agentische Automatisierung messbare Verbesserungen bei Geschwindigkeit, Effizienz, Skalierbarkeit und Anpassungsfähigkeit erzielen. Dort hingegen, wo Experimentieren Struktur ersetzt, werden Initiativen voraussichtlich scheitern, bevor sie den unternehmensweiten Einsatz erreichen.

Autonomie ohne Struktur ist Experiment. Autonomie innerhalb strukturierter Prozessarchitekturen ist Transformation.

Die Zukunft der Unternehmensautomatisierung wird nicht den autonomsten Systemen gehören – sondern den Organisationen, die GenAI gezielt steuern und kontrolliert in ihre Prozessarchitekturen einbetten.